上回,咱们说到了“传统语音降噪”里的各路江湖门派。

干货周记:趣说“语音降噪”(一)(番外篇17)

干货周记:趣说“语音降噪”(二)(番外篇18)

虽说各大门派都曾风光一时,也都是武林中的经典侠客,但却也难免,各有各的软肋,比如当非稳态等“花式噪声”入侵时,很多选手是招架不住的。

然而,这些老师傅们,既然能一直与AI并存,自然也有其道理(算得快、功耗低、占用资源少),“冷兵器”和“火药"都有自己的用武之地。

如果说“传统降噪”是封闭式游戏,那么“AI降噪”就是开放式的游戏世界,而且在这里,氪金很好使。

上次说过,Roy在一个论坛活动上,碰到了一个语音降噪的demo,效果奇好,上前询问,得知其用了一个口碑不错的AI模型,代价是其对算力和资源的消耗巨大,一般的DSP跑不下。

很多时候,只要钱给够,无脑上“高制程芯片”+“AI大参数/计算算法”,效果就能嘎嘎好。这也让Roy发现了件事儿:很多原先“手艺人”的绝世妙招,在AI日益精进的衬托之下,开始变得黯淡了。

很多学者毕生研究出的独门秘技,可能一出门,就被隔壁小王的AI模型,给秒杀了。这一幕是不是很戏剧?

(说到AI,顺便提一下,非常开心看到咱Deepseek和Kimi的崛起,这还真是个不错的新年礼物)。

一、AI降噪小历史

早期的AI降噪,很多是基于支持向量机SVM的,但它的局限也明显:不善于处理非结构化数据,当数据复杂时,效果明显会受限。

然后,基于“简单神经网络的AI降噪”开始兴起,从SVM到NN,在自由度上前进了一大步。但这个阶段,还主要以单纯基于CNN、RNN和DNN的模型为主,威力有限,效果谈不上有多好。

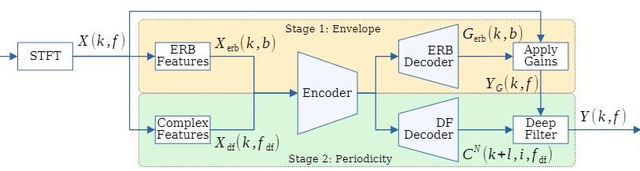

再然后,基于“混合神经网络的AI降噪”上线了,包括“实数神经网络”、“复数神经网络”、“端到端时域神经网络”、“单阶段处理”、“多阶段处理”等模型的玩法,层出不穷。以Roy有限的了解,“复数神经网络+多阶段处理”是目前的佼佼者,其降噪效果,已经可以令人称奇了。

二、基础概念

在聊AI降噪之前,咱得先了解几个概念:

DNN:深度神经网络。它像个大脑。有很多层神经元。数据从最外层神经元进去,每层神经元都会根据自己所学,对输入数据处理,最后由末层输出预测结果。这里的 “深度” 就是指可以有很多层,层级深。

补充:它包括输入层、隐藏层和输出层。隐藏层通常有很多层,神经元之间通过权重连接。数据在各层间传递,经过非线性激活函数处理,不断学习输入数据的复杂特征表示,用于解决分类、回归等各种问题。

CNN:卷积神经网络。它是个局部细节控,善于提取局部特征。它工作时,会拿“卷积核"去扫数据,一次就扫一小块。每扫完一块,就会得到一个特征值。扫完后,它还会做池化(类似无损压缩),精简信息,最后再做判别。

补充:通过卷积层对输入数据做卷积,用卷积核在数据上滑动,进行加权求和,提取局部特征。之后可能会由池化层,对数据下采样,减少数据量的同时,保留特征。最终由全连接层,做分类或回归。

RNN:循环神经网络。它是个记忆高手。RNN在处理数据时,会结合上一个处理结果,更好地去思考和理解。因为它记得前面的信息,所以可以敏锐地捕捉到数据上下文联系。它很适合处理像语音、文本这种有顺序的数据。

它的记忆力是咋来的?这主要归功于反馈连接,它允许信息在神经元之间循环流动。在处理序列数据x(t)时,此刻的隐藏状态h(t)不仅取决于x(t),还取决于上一时刻的隐藏状态h(t-1), 即,

其中 Wxh, Whh是权重矩阵,bh是偏置,f是非线性激活函数。这种结构能让RNN具备记忆力。

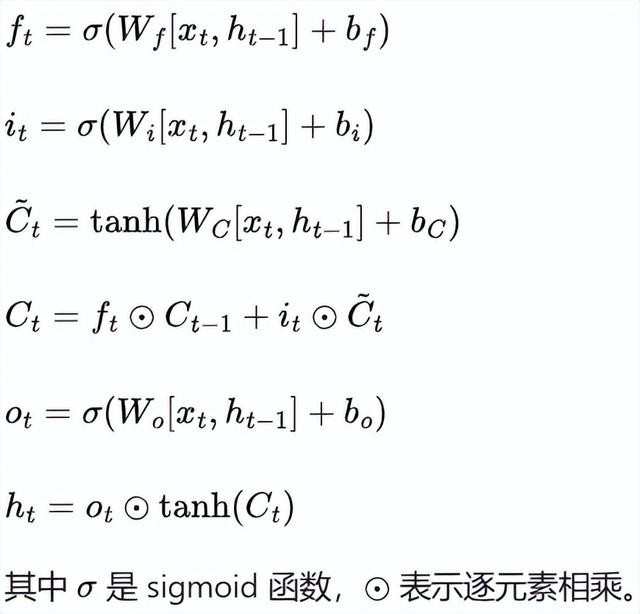

LSTM:长短期记忆网络。它是RNN 的“升级版”。RNN虽能记住前面的信息,但太长了也会忘。LSTM为加强记忆力,解决梯度爆炸等问题,引入了三个门。一个叫 “输入门”,它决定哪些新信息可以放入记忆;第二个是“遗忘门”,它可决定哪些旧信息可以忘掉;第三个是“输出门”,它决定取出哪些记忆信息来处理当前数据。

其中,Ct为记忆单元,it为输入门,ft为遗忘门,ot为输出门。

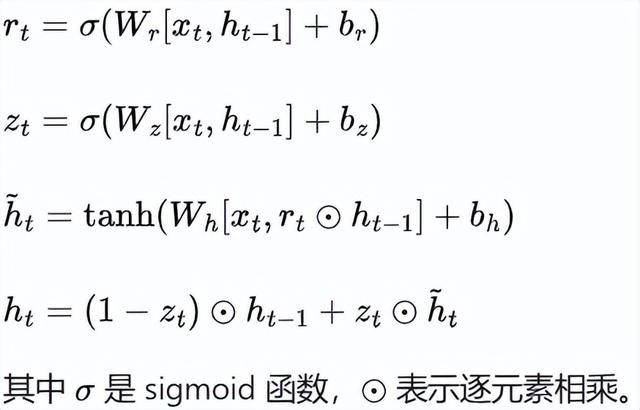

GRU:门控循环单元。它也是RNN改进版,和LSTM有点像,但更简洁一些。它只有两个门,一个”更新门”,决定要保留旧记忆还是接受新信息;一个“重置门”,决定要把多少旧记忆忘掉。它虽然没有 LSTM 那么复杂,效果也不差,而且计算起来,还更快。

其中,Zt是更新门,rt是重置门。“更新门”决定将多少过去的隐藏状态h(t-1)保留到此刻,“重置门”决定在当前候选隐藏状态对过去隐藏状态的依赖程度。

GAN:对抗生成网络。这是一场“艺术家”和“评论家”的较量。它有一个生成器,用来创作内容,还有一个判别器,用来判断内容的真伪。生成器努力创作,想骗过判别器,而判别器则努力提高自己的鉴别力,避免被骗到。在这个过程中,二者的水平都会不断地提升。

CRN:卷积递归神经网络。它是CNN和RNN的深度融合体。取二者之所长,可同时从时间和空间进行建模,既能得到精细的局部特征,又有全局特征的时间建模记忆力(通常会包含CED和递归层架构),此外,还有DPCRN, DCCRN...等等,不再赘述。

ERB和DF。

ERB指增强残差块:它是一种网络结构单元,其作用是进一步提高网络性能,通常在传统残差块基础上做了些改进,减少了运算复杂性,节省资源,也有助于更好地解决深度NN训练过程中的各种“梯度”问题。

DF即为导数,用于描述函数在某一点的变化率。神经网络里,导数主要用于计算损失函数对各个参数的梯度,以便进行反向传播和参数更新,让系统朝着损失函数最小化的方向进行训练。

编码器与解码器。

模型编码器:将“低纬度高复杂度"信息,转为“高维度低复杂度”的特征信息,就像是把一篇文章的要点,提取要点,浓缩在一张卡片上一样。

模型解码器:就是上述的逆过程,就像从卡片上的关键词,恢复出原本文章内容。在AI降噪/增强应用中,它的输出就代表着清晰的语音信号。

好,了解完这些基本概念,咱以后再看到那些唬人的框图,就不至于再懵圈了。咱下期,也就可以不那么啰嗦了。

行,天儿也不早了,今儿就先聊到这儿,咱们下期给“AI降噪”收官。

End

Roy个人观点,仅供参考。

如果你对数码产品、英语学习和励志成长也感兴趣,也可关注各平台上的同名视频账号:微博、抖音、视频号,B站、小红书:科技朋克Roy,知乎:Roy